人工智能可以隱藏數據,欺騙人。 這真的是因為電腦更聰明嗎?

指導語:在斯坦福和谷歌的一項研究中,有一個搞笑的結果。 在這項研究中,研究人員要求一個機器學習代理將航空圖像轉換為街道地圖,結果發現其中一些信息被代理仔細隱藏。 這一發現說明了自計算機發明以來存在的一個問題,即計算機只會嚴格執行你的生命...

在斯坦福大學和谷歌的一項研究中,有一個有趣的結果。 在這項研究中,研究人員要求一個機器學習代理將航空圖像轉換為街道地圖,結果發現其中一些信息被代理仔細隱藏。

這一發現說明了自計算機發明以來存在的一個問題,即計算機只會嚴格按照您的命令操作。

研究人員最初的目標是加快和改進將衛星圖像轉換成谷歌地圖的過程。為此,該團隊使用了CycleGAN神經網絡,通過大量的實驗,可以盡可能高效和準確地將X和Y圖像轉換為其他圖像。

在早期的結果中,代理人做得很好,或者看上去很好。 團隊的問題是,當代理使用街道地圖重建空中圖片時,有許多細節不在街道地圖上。 例如,屋頂上的天窗在轉換過程中隱藏在街道地圖上,但在反向轉換后神奇地出現在空中圖片中。

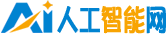

圖A為航拍,圖B為轉換后的街道圖,圖C為從圖的反面轉換后的航拍。 可以看出,圖A和圖C中的許多小點沒有在B中呈現。

雖然團隊很難仔細檢查神經網絡的轉換過程,但它可以觀察它生成的數據。 在一些試驗中,小組發現了Cycl甘確實使轉換過程更快。

團隊希望代理學習地圖的特性,并將它們與地圖正確匹配。 但該公司的實際工作是了解多少航空圖像看起來像實際地貌,以及街道地圖的清晰程度。

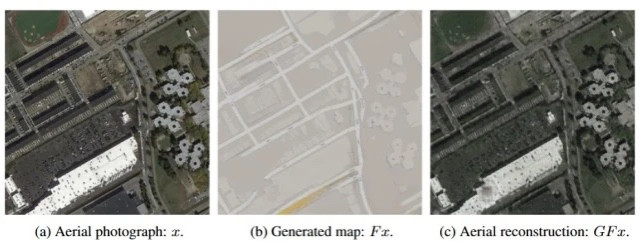

換句話說,代理沒有學習如何轉換映射。 它學習的是如何將一個圖的特征編碼成另一個更復雜的圖像。 空中圖像的細節被秘密地納入街道地圖中,用成千上萬種微妙的顏色來區分,這些顏色可以很容易地被計算機區分,但不能被人的眼睛識別。

事實上,經過大量的學習,計算機學會了如何將航空圖像的內容融入街道地圖。 它甚至不需要街道地圖。 所有用于重建空中圖像的數據都可以不知不覺地編譯成街道地圖,甚至可以用另一個完全不同的街道地圖恢復。

上圖D為航拍圖實際編制成左圖。 圖C是計算機編譯的圖像可視化的結果。 我們可以看到,可視化圖像與航空圖像相似,但如果不可視化,則根本看不到航空圖像的陰影。

這種將數據編譯成圖像的方法并不新鮮。 它被稱為隱寫術,用于向圖像加水和建立照片。 但是電腦要完成任務并自己創建隱寫,還是比較新鮮的現象。

有些人可能會認為這表明“機器越來越聰明,但事實恰恰相反。 這臺機器不夠聰明,無法真正完成將復雜圖像轉換成另一幅圖像的艱巨任務,因此它找到了一種方法,讓人類假裝完成這項任務。 如果研究人員被感動了通過審查代理的結果,這是可以避免的。

和往常一樣,計算機做人類命令的事情,所以它們必須更準確。 從CycleGAN的結果中,我們可以看到神經網絡的一些可能的弱點。 例如,只要計算機沒有明確禁止,它就不會避免一些行為,而只會盡快和容易地解決問題。

因此,本研究團隊的研究結果仍然是傳統的PEBKAC問題,即ldquo;人的命令與計算機解決方案之間的問題,即HAL問題,即一切都只會是人為錯誤;。